TEMA KÄLLKRITIK

Professorn: AI-chatbotar avslöjar inte sina källor

I dag behöver lärare förstå AI-teknikens grunder och sätta sig in i hur chatbotar fungerar, menar Arnold Pears, professor vid KTH.

– Vi kan aldrig överblicka de enorma datamängder som AI-chatbotarna är baserade på och får aldrig veta exakt vilka källorna är. När verktygen utvecklas minskar behovet av att förstå detaljerna om AI-teknik – men vi är inte där ännu.

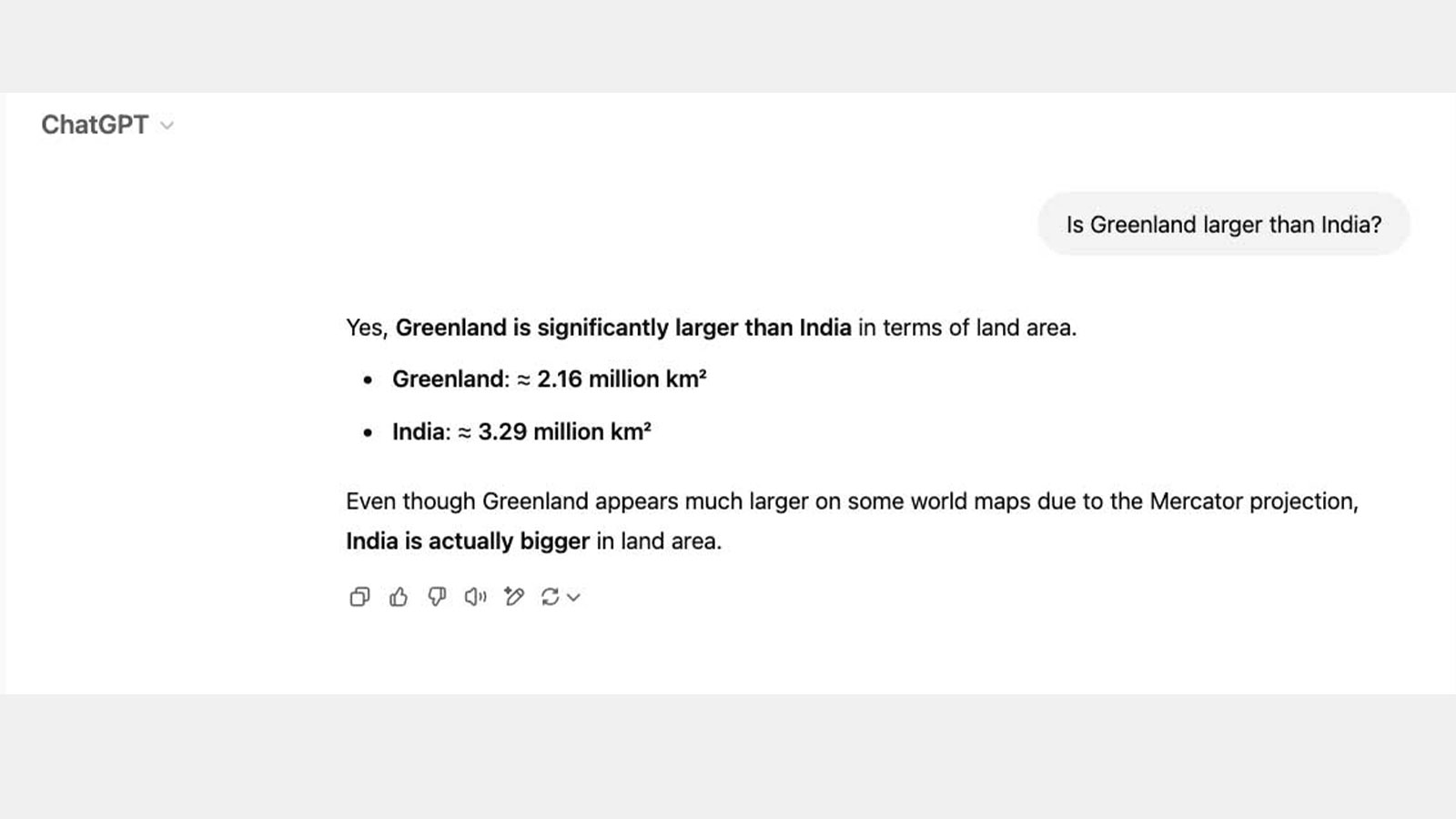

Svaret från en AI-chatbot som exempelvis ChatGPT, Gemini eller Claude är baserad på en mängd data och beräkningar, men exakt vilka källorna är eller om svaret är en gissning eller hämtat från en relevant källa kräver mer information än svaret ger. Trots det används chatbotar som bygger på generativ AI i allt större utsträckning som faktakällor.

– Det finns stora fördelar med de här generella maskininlärningsmodellerna, AI-chatbotarna. De klarar av mycket mer än vad de är tränade på och klarar uppgifter som ligger utanför de ursprungliga syftena förvånansvärt bra, säger Arnold Pears som är professor vid institutionen Lärande på KTH i Stockholm.

Mångsidigheten och användbarheten har gjort AI-chatbotarna, som Arnold Pears skämtsamt kallar ”hitta på-maskiner”, populära både för nöje och nytta. De har framför allt utvecklats för att presentera information på ett lättförståeligt och anpassat sätt beroende på sammanhang och för att hantera och skapa text, översätta språk och svara på frågor – och de anpassas hela tiden för att bli framgångsrika kommersiella tjänster på en konkurrensutsatt marknad.

Lärare behöver kunna AI-tekniken

Men trots förmågan att snabbt producera välformulerade och tydliga svar är tjänsterna inte alls tillförlitliga som faktakällor och det är helt logiskt med tanke på hur de konstruerats, hävdar Arnold Pears som menar att lärare i dag behöver kunna grunderna för hur generativ AI är uppbyggd och hur tekniken fungerar.

– När en ny teknologi introduceras och blir relevant har det alltid funnits en oro att något kan bli väldigt fel om man överlåter ansvaret till tekniken eller någon annan än en själv. När bilen blev tillgänglig för gemene man behövde bilägaren veta vad som dolde sig under huven och hur en förbränningsmotor fungerade, men i dag förväntar jag mig som bilägare att kunna starta bilen och köra utan att veta vilka kretskort och datorprogram som används.

På motsvarande sätt kommer AI-tekniken att utvecklas menar Arnold Pears som ser en stor potential att generativ AI kan förändra hur vi förhåller oss till kunskap och kunskapsinhämtning. Men den snabba utvecklingen kräver ett visst förhållningssätt för exempelvis lärare.

– I det här skedet, när teknologin är i sin linda, behöver vi förklara, förändra och bidra till bildningen. Så småningom kommer man få större tillit till verktygen och har implementerat lagstiftning, regler och rutiner som garanterar vissa grundegenskaper. När utvecklingen har kommit så långt behöver man som lärare framför allt förstå AI-tekniken på en abstrakt nivå och hur det påverkar tillförlitligheten.

Statistiska probabilistiska nätverk

– Om du som lärare ska in i klassrummet idag och prata om användarspecifik generativ AI, stora språkmodeller – LLM, large language models – kan det vara viktigt för elevernas förståelse, och hur de måste förhålla sig till de verktygen, att de lär sig grunderna kring hur tjänsterna är uppbyggda och hur de fungerar, menar Arnold Pears som lyfter fram ett par grundläggande punkter som är relevanta för förståelsen:

- Språkmodellerna baseras på mönster över hur olika saker påverkar varandra, så kallade statistiska probabilistiska nätverk, där varje påverkan har en viss sannolikhet. För att kunna bygga upp språkmodeller för generativ AI krävs mönster som byggs upp utifrån stora datamängder. Mönstren relaterar till varandra och har ingen direkt koppling till verkligheten. Språkmodellernas svar kan upplevas som resonerande, men är endast statistiskt sannolika svar baserade på datan.

- En språkmodell för generativ AI, exempelvis en stor AI-chatbot, kommer att spegla mönster som finns i de stora datamängderna som den tränats på.

– Problemet är att vi aldrig kan veta vilka källor som datan kommer från eftersom utvecklarna inte avslöjar vad de har tränat modellerna på. Det finns bland annat juridiska och affärsmässiga anledningar till det.

Arnold Pears efterlyser en medvetenhet om teknikens möjligheter och begränsningar.

Datan som de stora språkmodellerna i grunden är baserade på, som de tränats på, är hämtad från bland annat webbsidor, nyhetsartiklar, kunskapsdatabaser som Wikipedia, akademiska skrifter, myndigheter, diskussionsforum, böcker med mera och den datan är avgörande för hur svaren utformas oavsett om ny data hämtas från källor som anges.

– Alla faktorer som ingår i underlaget för ett svar behöver inte vara sanna trots att chatroboten har tillgång till alla fakta. Exempelvis om det finns mycket skrivet om en historisk person, kanske en kung, så har mycket av det som återberättats om honom och den tidsperioden använts för att träna upp de stora språkmodellerna. Skulle det saknas detaljer i datan som ändå sannolikt skulle kunna vara på ett visst sätt så kan de detaljerna ändå ingå i ett svar. Man måste alltså bekräfta alla svar med en tillförlitlig källa för att kunna bedöma trovärdigheten i svaret.

Mer anpassade modeller

Arnold Pears förutsätter att det kommer att utvecklas språkmodeller som är mer anpassade till utbildningssituationer där man tvingar modellen att använda enbart data från trovärdiga källor och tränar upp den på tillförlitliga källor, men är tveksam till att det som i dag kallas responsible AI eller explainable AI lever upp till förväntningarna som begreppen antyder.

Att förmänskliga generativ AI genom att kalla information som låter övertygande, men som är felaktig eller påhittad för hallucinationer är också missvisande menar Arnold Pears.

– Att hallucinera förutsätter att man vet vad sanningen är eller att man i någon mening är påverkad så att man hittar på någonting som inte är sanningen, men språkmodellerna är inte påverkade av någonting och vet inte vad sanningen är. Det är logiskt att svar som har väldigt hög sannolikhet inte nödvändigtvis är korrekt.

Använd rätt sorts AI!

Arnold Pears tror att AI kan vara en enorm resurs i undervisningen och för samhället, men efterlyser en medvetenhet om teknikens begränsningar.

– Låt oss använda rätt sorts AI för sitt respektive syfte!

Tillsammans med andra lärare och forskare utvecklar Josefine Reimark en undervisningsmodell för att utveckla elevernas granskning av trovärdighet i naturvetenskapliga påståenden i media. När studien, som finansieras av Skolforskningsinstitutet, publiceras kommer den att länkas till från listan härintill.

Arnold Pears är professor vid institutionen Lärande på KTH i Stockholm.

Lästips och referenser

- KTH. Arnold Pears.

kth.se/profile/pears?l=sv